我承认,这次我们真翻车了!

前不久博采发布了一条LED棚翻车视频,在业内炸开了锅。

开头大全景怎么拍出来的?

动捕的意义是做分镜么?

激光扫描就扫了个车,真的有必要吗?

气囊和撞坏的前盖、前挡玻璃是咋回事?

不懂为何不让两个演员直接上去操作,还要替身表演动作,然后后期再去合成?

是因为替身训练过吗? aqua park inflatable

…………

朋友们对制作过程表现出极大兴趣,我们决定用这篇文章详细聊聊整个虚拟制作幕后。

下面干货预警!

1.开场镜头怎么拍的?

不卖关子,这就是一个全CG镜头。

因为不需要带到演员,这个镜头在UE里进行镜头调度,进行实时渲染。

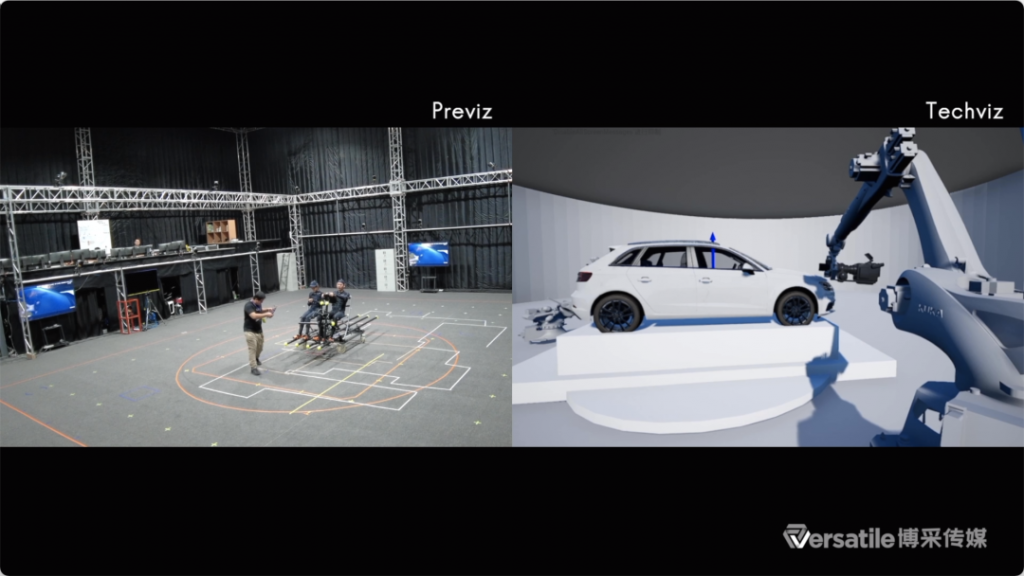

值得一提的是,镜头运动轨迹提前通过Previz和Techviz规划好,所有镜头数据精准继承到实拍,这个CG画面才能够与实拍镜头完美衔接,实现一镜到底的效果。(关于Previz可以到这儿了解更多:https://versatile.media/?p=1660)

这就涉及到另一个问题,也是大家问的比较多的:动捕、激光扫描汽车、以及替身演员的意义是什么?

2.从实时previz到techviz

视频中可以看到,现场拍摄涉及到演员、汽车与几种机械装置以及环幕场景的紧密配合。

稍有误差,就会出现设备撞击事故,那就真“翻车”了。

因此,Previz(视觉预览)和Techviz(技术预演)尤为必要。

如果把成片比作一栋建筑,Previz就是效果图,怎么好看怎么来;Techviz就像施工图纸,让现场工人知道该怎么施工,需要能够落地执行。

Previz环节,导演确定了运镜、演员动作、影片节奏,之后各项数据就移交给Techviz团队,进行拍摄方案规划、技术流程拆解、方案可行性测试。

为了技术预演的精确度,避免实拍时出现机械臂撞车惨案,在资产环节,资产团队采用三维激光扫描的方式,一比一做出汽车的数字模型。

注意,扫描时甚至已经把汽车放在四轮仿真模拟装置上,确保底盘高度、车辆高度、倾斜程度、车内空间等细节都与实拍无误。

Techviz基于Previz的镜头运动数据,通过相对运动转化、现实与虚拟置景匹配等技术,将数据反向给到机械臂,确定机械臂的运动轨迹、以及同时刻环幕匹配画面。

此外,四轮仿真平台通过数控与电脑联通,根据虚拟世界中的路面高低完成数据反求,模拟汽车震动效果。

3.自研MoboCon系统

Techviz打造了一套落地方案,把大部分汽车的运动转移给LED屏幕内的虚拟场景,车辆基本不需要移动,仅依靠摄影机和背景屏幕的变化,就实现翻车的视觉效果。

技术实现没有问题,但现场拍摄时,如何给所有设备发布指令,让它们在对的时间做对的事?

博采自研MoboCon系统此时就派上了用场。

这是一套联动操控机械设备以及UE的系统,可以同时控制多架机械臂、四轮仿真平台、摄影机控制板和UE场景,所有轨迹数据通过Techviz继承而来,1个操作员就实现了传统流程5个人的工作。

MoboCon系统能够与UE数据打通。UE中调整虚拟Bolt、Hilo和Tilex等机械臂的运动可以同步给到MoboCon,反之MoboCon中调整现实世界机械臂的运动轨迹也可以反向输送给UE中的虚拟世界。

MoboCon还能够同步操控摄影机控制平台Gyro,视频最后车辆倒转的画面,就是Gyro旋转镜头拍摄出来的。

MoboCon系统能够有效驱动所有机械设备,正是得益于博采进行的底层设计与研发,不仅在软件层面,在硬件设备上,配套产品都是自己开发的,比如机械臂Hilo和Tilex、四轮模拟平台Turret、相机转盘Gyro和Quad等等,都是博采自研产品,也是博采虚拟制片体系的重要组成部分。

4.现场实时物理特效

有朋友好奇,车窗玻璃上的裂纹是后期加上去的吗?

答案或许会让你大跌眼镜:这其实是贴的对折透明胶。

现场拍摄时,先拍一遍没有贴透明胶的画面,利用机械臂精准重复运动的优势,再拍摄一遍有透明胶的,因为镜头轨迹完全一致,后期找到恰当位置替换掉即可。

安全气囊、落叶也是同理。

传统流程中需要耗费大量成本、充满不确定性和危险性的悬崖翻车戏,通过数据打通的虚拟制片流程,可以安全、高效、可控地完成,并且可以满足导演大调度和复杂运镜的拍摄需求,拍到实拍根本不敢拍或不能拍的画面。

好了,以上就是全部幕后详解,希望你的疑问有被解答。